Confrontation Anthropic-Pentagone sur l'IA : La Position Éthique Inflexible du PDG Face aux Exigences Militaires

BitcoinWorld

Conflit IA Anthropic-Pentagone : La position éthique défiante du PDG face aux exigences militaires

WASHINGTON, D.C. — 13 octobre 2025 — Dans une escalade spectaculaire des tensions entre la Silicon Valley et le Pentagone, le PDG d'Anthropic, Dario Amodei, a publiquement refusé un ultimatum du Département de la Défense exigeant un accès illimité aux systèmes d'intelligence artificielle avancés de l'entreprise. Avec moins de 24 heures restantes avant une échéance critique, Amodei a déclaré qu'il « ne peut en toute bonne conscience accéder » aux demandes militaires qui permettraient une surveillance de masse des Américains et un déploiement d'armes entièrement autonomes. Ce bras de fer sans précédent représente un moment déterminant pour la gouvernance de l'IA, opposant les impératifs de sécurité nationale aux principes éthiques fondamentaux dans le développement de l'intelligence artificielle.

Le conflit IA Anthropic-Pentagone atteint l'échéance critique

La confrontation se concentre sur l'échéance du vendredi 17 h 01 fixée par le secrétaire à la Défense Pete Hegseth pour qu'Anthropic se conforme aux exigences militaires ou subisse de graves conséquences. Selon des documents internes examinés par plusieurs sources, le Pentagone cherche un contrôle opérationnel complet sur les systèmes Claude d'Anthropic pour « toutes fins légales ». Cependant, la déclaration de jeudi d'Amodei expose deux restrictions non négociables : l'interdiction de la surveillance de masse des citoyens américains et l'interdiction des systèmes d'armes entièrement autonomes sans supervision humaine.

Anthropic occupe actuellement une position unique en tant que seul laboratoire d'IA de pointe disposant de systèmes prêts pour les applications classifiées certifiés pour les applications militaires. Cet avantage technologique confère à l'entreprise un levier significatif mais en fait également une cible pour les pressions du Département de la Défense. Le Pentagone a menacé de deux mesures contradictoires pour contraindre la conformité :

- Désignation de risque de chaîne d'approvisionnement : Qualifier Anthropic de menace pour la sécurité nationale, généralement réservé aux adversaires étrangers

- Invocation du Defense Production Act : Utiliser l'autorité présidentielle pour forcer l'entreprise à prioriser la production militaire

Amodei a souligné cette contradiction dans sa déclaration, notant : « L'une nous qualifie de risque pour la sécurité ; l'autre qualifie Claude d'essentiel à la sécurité nationale. » Cette ambiguïté stratégique reflète la relation complexe du Pentagone avec les développeurs d'IA privés qui contrôlent des technologies critiques.

Limites éthiques dans l'intelligence artificielle militaire

Le désaccord fondamental s'étend au-delà des termes contractuels à des différences philosophiques fondamentales sur le rôle de l'IA dans la défense nationale. La position d'Amodei reflète l'approche Constitutional AI d'Anthropic, qui intègre les considérations éthiques directement dans l'architecture du système. Le refus de l'entreprise se concentre sur deux applications spécifiques qu'elle considère au-delà des limites acceptables :

| Application restreinte | Justification d'Anthropic | Position du Pentagone |

|---|---|---|

| Surveillance de masse des Américains | Mine les valeurs démocratiques et les protections de la vie privée | Essentielle pour la détection des menaces à la sécurité nationale |

| Armes entièrement autonomes | La technologie actuelle ne peut garantir un déploiement fiable et éthique | Maintient l'avantage technologique militaire |

Ce cadre éthique émerge de la structure d'entreprise unique d'Anthropic en tant que Public Benefit Corporation, qui oblige légalement l'entreprise à considérer les impacts sociétaux aux côtés des intérêts des actionnaires. Pendant ce temps, les responsables du Département de la Défense soutiennent que les entreprises privées ne devraient pas dicter la stratégie militaire ou le développement des capacités. Ils maintiennent que les utilisations légales de l'IA devraient rester entièrement à la discrétion du gouvernement.

Contexte historique des partenariats militaire-technologie

Le bras de fer actuel fait suite à des décennies de relations évolutives entre les établissements de défense et les innovateurs technologiques. Pendant la Seconde Guerre mondiale, des entreprises comme Bell Labs et IBM ont travaillé en étroite collaboration avec les agences militaires sans contraintes éthiques significatives. La Guerre froide a vu des collaborations similaires avec des entreprises aérospatiales et informatiques. Cependant, le 21e siècle a introduit de nouvelles complexités alors que les entreprises de technologie grand public développaient des capacités surpassant les systèmes militaires spécialisés.

Ces dernières années ont été témoins d'une tension croissante entre les travailleurs de la technologie et les contrats militaires. En 2018, les employés de Google ont réussi à faire pression sur la direction pour abandonner Project Maven, une initiative d'IA du Pentagone pour l'analyse d'imagerie de drones. Microsoft et Amazon ont fait face à des protestations internes similaires concernant les contrats de défense. La position actuelle d'Anthropic représente la résistance la plus formalisée et publique d'une entreprise d'IA confrontée à une pression gouvernementale directe.

Implications pour la sécurité nationale et solutions alternatives

Le calendrier urgent du Pentagone reflète de véritables préoccupations en matière de sécurité nationale. Les planificateurs militaires considèrent de plus en plus l'IA avancée comme essentielle pour maintenir des avantages stratégiques contre les concurrents quasi pairs. Les systèmes autonomes pourraient améliorer tout, de l'optimisation logistique à la cyberdéfense. Cependant, Amodei propose une voie médiane qui maintient la coopération tout en respectant les limites éthiques.

Dans sa déclaration, le PDG a souligné : « Notre forte préférence est de continuer à servir le Département et nos combattants — avec nos deux garanties demandées en place. » Il s'est en outre engagé à faciliter une transition en douceur si le Pentagone choisit des fournisseurs alternatifs, mentionnant spécifiquement que le Département « prépare apparemment xAI pour le travail ». Cette référence à l'entreprise d'Elon Musk suggère que le Département de la Défense a préparé des plans de contingence.

Les conséquences potentielles d'une séparation complète sont significatives. Les systèmes d'Anthropic soutiennent actuellement plusieurs programmes militaires classifiés, et les périodes de transition pourraient créer des lacunes de capacités. Cependant, l'approche coopérative d'Amodei pour le départ démontre une compréhension pragmatique des priorités de sécurité nationale tout en maintenant les limites éthiques.

Paysage juridique et réglementaire pour la gouvernance de l'IA

Cette confrontation se produit au milieu de cadres réglementaires évolutifs pour l'intelligence artificielle. L'AI Act de l'Union européenne établit des limitations strictes sur certaines applications militaires, tandis que les États-Unis ont poursuivi une approche plus flexible par le biais d'ordres exécutifs et d'orientations d'agence. Le Defense Production Act, mis à jour pour la dernière fois en 2020, fournit la base juridique pour l'action menacée du Pentagone.

Les experts juridiques notent plusieurs aspects sans précédent de cette situation. Jamais auparavant une entreprise technologique n'a publiquement refusé une invocation du Defense Production Act avant qu'elle ne se produise. De plus, la désignation de risque de chaîne d'approvisionnement s'applique généralement aux entités étrangères, pas aux entreprises nationales. Ces circonstances nouvelles pourraient établir d'importants précédents pour les futures relations gouvernement-technologie.

Les comités du Congrès ont déjà annoncé des audiences pour examiner les implications plus larges. Les législateurs des deux partis ont exprimé des préoccupations concernant soit la compromission de la sécurité nationale, soit l'érosion des normes éthiques dans le développement de l'IA. Le résultat pourrait influencer la législation en attente sur la sécurité de l'IA et les applications militaires.

Réactions de l'industrie et dynamiques concurrentielles

Les réponses des autres entreprises d'IA ont été mesurées mais révélatrices. OpenAI a refusé de commenter spécifiquement mais a fait référence à ses politiques existantes restreignant certaines applications militaires. Google a souligné son travail de défense en cours tout en notant que ses Principes d'IA interdisent le développement d'armes. xAI n'a pas publiquement abordé les rapports de préparations du Pentagone mais a précédemment exprimé sa volonté de travailler avec les agences de défense.

Les implications concurrentielles sont substantielles. Si Anthropic perd des contrats militaires, ses revenus pourraient diminuer considérablement, affectant potentiellement les budgets de recherche et développement. À l'inverse, les entreprises prêtes à accepter moins de restrictions pourraient obtenir des avantages concurrentiels sur les marchés de la défense. Cette dynamique crée une pression sur les normes éthiques dans l'ensemble de l'industrie.

Considérations techniques dans le déploiement de l'IA militaire

Au-delà des préoccupations éthiques, la déclaration d'Amodei fait référence aux limitations techniques. Les systèmes d'IA actuels, même les modèles avancés comme Claude, présentent des vulnérabilités notamment :

- Attaques adversariales : Susceptibilité aux entrées manipulées causant des sorties incorrectes

- Défis d'interprétabilité : Difficulté à comprendre comment les systèmes parviennent à des décisions spécifiques

- Dépendance aux données : Exigence de données d'entraînement étendues et de haute qualité

- Limitations de contexte : Incapacité à comprendre pleinement des scénarios complexes du monde réel

Ces contraintes techniques rendent certaines applications militaires particulièrement risquées. Les systèmes d'armes autonomes opérant dans des environnements dynamiques pourraient mal interpréter des situations avec des conséquences catastrophiques. Les systèmes de surveillance de masse pourraient générer des faux positifs avec de graves implications pour les libertés civiles. La position d'Anthropic reconnaît à la fois les limitations éthiques et pratiques de la technologie actuelle.

Conclusion

Le bras de fer IA Anthropic-Pentagone représente un moment charnière pour l'éthique technologique et la sécurité nationale. Le refus par principe de Dario Amodei de fournir un accès militaire illimité établit de nouvelles limites pour la responsabilité d'entreprise dans le développement de l'intelligence artificielle. Alors que l'échéance de vendredi approche, le résultat influencera non seulement les relations gouvernement-contractant mais aussi les normes sociétales plus larges pour le déploiement de l'IA. Que ce soit par le compromis ou la séparation, cette confrontation façonnera la façon dont les sociétés démocratiques équilibrent les besoins de sécurité avec les principes éthiques dans un monde de plus en plus piloté par l'IA. La résolution pourrait déterminer si les entreprises privées peuvent maintenir des garde-fous éthiques lorsque leurs technologies croisent les priorités de défense nationale.

FAQs

Q1 : Quelles applications d'IA spécifiques Anthropic refuse-t-elle de fournir au Pentagone ?

Anthropic ne permettra pas la surveillance de masse des citoyens américains ou les systèmes d'armes entièrement autonomes sans supervision humaine. L'entreprise cite à la fois des préoccupations éthiques et des limitations techniques de la technologie d'IA actuelle.

Q2 : Quelle autorité légale le Pentagone a-t-il pour contraindre la coopération d'Anthropic ?

Le Département de la Défense a menacé d'invoquer le Defense Production Act, qui donne au président l'autorité de prioriser la production militaire, ou de désigner Anthropic comme un risque de chaîne d'approvisionnement, généralement réservé aux adversaires étrangers.

Q3 : Comment la position d'Anthropic se compare-t-elle aux politiques militaires des autres entreprises d'IA ?

Anthropic adopte la position publique la plus restrictive, avec des refus formels d'applications spécifiques. Google interdit le développement d'armes mais autorise d'autres travaux de défense. OpenAI restreint les applications « militaires et de guerre » mais les définitions restent flexibles.

Q4 : Que se passe-t-il si Anthropic et le Pentagone ne peuvent pas parvenir à un accord ?

Anthropic s'est engagée à faciliter une transition en douceur vers des fournisseurs alternatifs, mentionnant que le Pentagone prépare des systèmes xAI. Cela pourrait créer des lacunes de capacités temporaires mais ne compromettrait probablement pas de manière permanente l'accès militaire à l'IA.

Q5 : Comment la structure d'entreprise d'Anthropic influence-t-elle sa position éthique ?

En tant que Public Benefit Corporation, Anthropic a des obligations légales de considérer les impacts sociétaux aux côtés des intérêts financiers. Cette structure fournit une base formelle pour les décisions éthiques qui pourraient être en conflit avec les opportunités commerciales à court terme.

Cet article Conflit IA Anthropic-Pentagone : La position éthique défiante du PDG face aux exigences militaires est apparu en premier sur BitcoinWorld.

Vous aimerez peut-être aussi

Block de Jack Dorsey supprime 40 % de son personnel dans une restructuration majeure axée sur l'IA

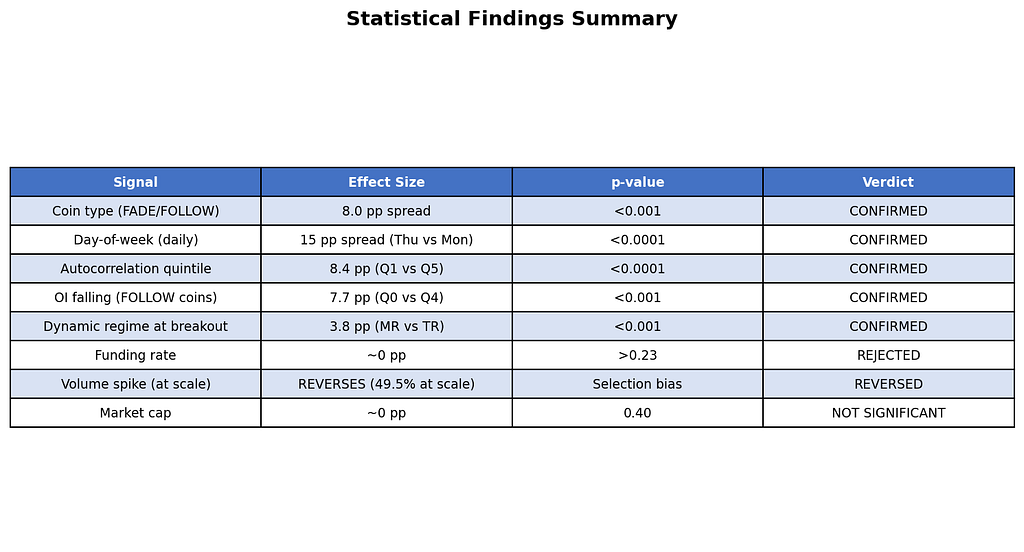

J'ai analysé 31 810 cassures crypto. Voici ce qui prédit réellement les vraies des fausses.