Liste noire du Pentagone d'Anthropic : Le piège dévastateur de l'autorégulation de l'IA révélé

BitcoinWorld

Liste noire du Pentagone pour Anthropic : Le piège dévastateur de l'autorégulation de l'IA exposé

Dans un développement stupéfiant vendredi après-midi qui a envoyé des ondes de choc à travers la Silicon Valley et Washington D.C., le Département de la Défense des États-Unis a rompu ses liens avec Anthropic, déclenchant une perte catastrophique de contrat de 200 millions de dollars et exposant le piège fondamental de l'autorégulation dans l'intelligence artificielle. La société d'IA basée à San Francisco, fondée par d'anciens chercheurs d'OpenAI sur des principes de sécurité, fait maintenant face à une liste noire du Pentagone après avoir refusé de développer une technologie pour la surveillance de masse domestique et les drones tueurs autonomes. Cette mesure sans précédent, invoquant les lois de sécurité nationale sur la chaîne d'approvisionnement contre une entreprise américaine, révèle un vide réglementaire dangereux dont des experts comme le physicien du MIT Max Tegmark ont averti pendant des années. La crise démontre comment la résistance des entreprises d'IA à une surveillance contraignante a créé une amnistie d'entreprise avec des conséquences potentiellement dévastatrices.

Liste noire du Pentagone pour Anthropic : Un tremblement de terre de sécurité nationale

La décision de l'administration Trump représente un changement sismique dans les relations gouvernement-IA. Le secrétaire à la Défense Pete Hegseth a invoqué la Section 889 du National Defense Authorization Act de 2019, une législation conçue pour contrer les menaces étrangères à la chaîne d'approvisionnement, pour mettre Anthropic sur liste noire de toutes les affaires du Pentagone. Cela a marqué la première application publique de cette loi contre une entreprise technologique nationale. Le président Trump a amplifié l'action avec un message sur Truth Social ordonnant à chaque agence fédérale de "cesser immédiatement toute utilisation de la technologie Anthropic". Le refus de l'entreprise s'est centré sur deux lignes rouges éthiques : développer l'IA pour la surveillance de masse des citoyens américains et créer des drones armés autonomes capables de sélectionner et de tuer des cibles sans intervention humaine. Anthropic a annoncé son intention de contester la désignation en justice, la qualifiant de "juridiquement infondée", mais les dommages financiers et de réputation immédiats sont substantiels.

Le vide réglementaire et l'amnistie d'entreprise

Max Tegmark, fondateur du Future of Life Institute et organisateur de la lettre de pause sur l'IA de 2023, fournit une analyse sans concession de la crise. "Le chemin de l'enfer est pavé de bonnes intentions", a-t-il remarqué lors d'une interview exclusive. Tegmark soutient qu'Anthropic, avec OpenAI, Google DeepMind et xAI, a constamment fait pression contre la réglementation contraignante de l'IA tout en faisant des promesses de sécurité volontaires. "Nous avons actuellement moins de réglementation sur les systèmes d'IA en Amérique que sur les sandwichs", a-t-il noté, soulignant l'absurdité du paysage actuel. Un inspecteur alimentaire peut fermer un magasin de sandwichs avec des violations sanitaires, mais aucune autorité équivalente n'existe pour empêcher les déploiements d'IA potentiellement dangereux. Ce vide réglementaire crée ce que Tegmark appelle "l'amnistie d'entreprise" — une situation où les entreprises ne font face à aucune conséquence juridique pour des actions potentiellement nuisibles jusqu'à ce qu'un désastre survienne.

Chronologie des promesses brisées

L'érosion des engagements de sécurité de l'IA suit un schéma troublant à travers les grandes entreprises :

- Google : A abandonné la devise "Don't be evil", puis abandonné les engagements plus longs de prévention des dommages de l'IA

- OpenAI : A supprimé la "sécurité" de sa déclaration de mission principale en 2024

- xAI : A fermé toute son équipe de sécurité lors de la restructuration de 2025

- Anthropic : A abandonné son engagement central de sécurité plus tôt cette semaine, promettant de ne pas publier de systèmes puissants jusqu'à ce qu'il soit confiant qu'ils ne causeraient pas de dommages

Ce schéma révèle ce que Tegmark appelle "marketing contre réalité" — des entreprises promouvant des récits de sécurité tout en résistant aux réglementations qui rendraient ces promesses applicables. L'absence de cadres juridiques signifie que ces engagements restent optionnels et révocables à la discrétion de l'entreprise.

Le sophisme de la course avec la Chine et les réalités de sécurité nationale

Les entreprises d'IA contrent fréquemment les propositions réglementaires avec l'argument de la "course avec la Chine", suggérant que tout ralentissement céderait l'avantage à Pékin. Tegmark démantèle ce raisonnement avec une analyse convaincante. "La Chine est en train d'interdire purement et simplement les petites amies IA", note-t-il, expliquant que les autorités chinoises considèrent certaines applications d'IA comme des menaces pour la stabilité sociale et le développement des jeunes. Plus fondamentalement, il questionne la logique de courir vers la superintelligence sans mécanismes de contrôle. "Qui dans son bon sens pense que Xi Jinping va tolérer qu'une entreprise chinoise d'IA construise quelque chose qui renverse le gouvernement chinois ?" Cette perspective recadre la superintelligence d'un atout national à une menace de sécurité nationale — une vision qui peut gagner du terrain à Washington suite à la mise sur liste noire d'Anthropic.

Progrès technique contre retard de gouvernance

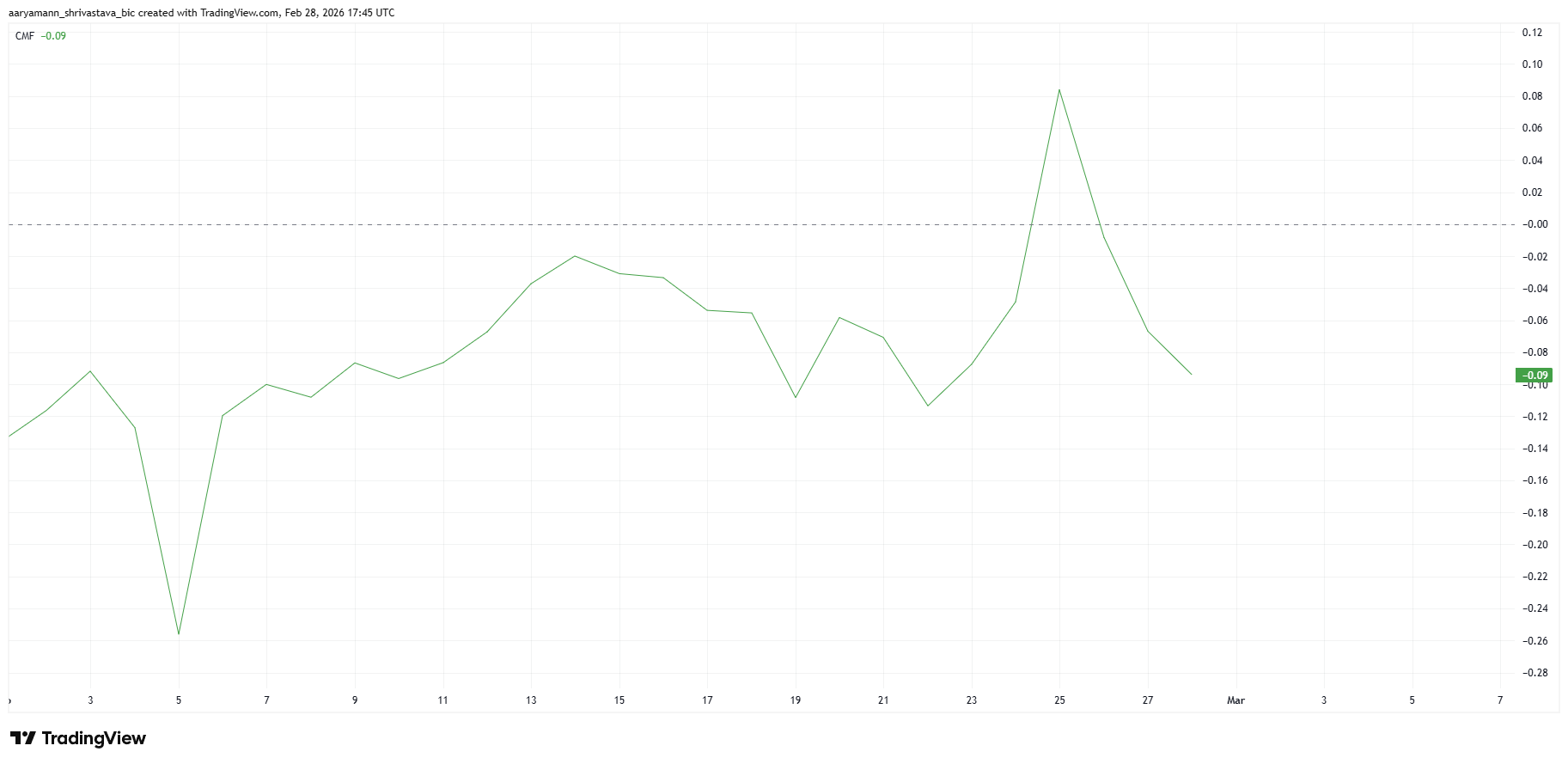

La vitesse de l'avancement de l'IA a largement dépassé les structures de gouvernance. Tegmark cite des recherches récentes montrant que GPT-4 a atteint 27 % des critères rigoureusement définis d'Intelligence Artificielle Générale (AGI), tandis que GPT-5 a atteint 57 %. Cette progression rapide des capacités du lycée au niveau doctorat en quelques années seulement a créé ce que les experts appellent un "écart de gouvernance". Le tableau ci-dessous illustre l'accélération :

| Année | Étape de l'IA | Réponse de la gouvernance |

|---|---|---|

| 2022 | GPT-3 démontre la génération de texte de type humain | Directives éthiques volontaires proposées |

| 2023 | GPT-4 réussit les examens professionnels | Lettre de pause avec 33 000 signatures ; aucune action contraignante |

| 2024 | L'IA gagne les Olympiades internationales de mathématiques | Émergence de politiques nationales fragmentées |

| 2025 | GPT-5 atteint 57 % des critères AGI | Le Pentagone utilise la loi sur la chaîne d'approvisionnement contre Anthropic |

Cette déconnexion entre capacité technique et cadre réglementaire crée ce que Tegmark décrit comme "la période la plus dangereuse" — lorsque les systèmes deviennent suffisamment puissants pour causer des dommages significatifs mais restent largement non gouvernés.

Réactions de l'industrie et carrefour stratégique

La mise sur liste noire d'Anthropic force les autres géants de l'IA à révéler leurs positions. Le PDG d'OpenAI, Sam Altman, a rapidement annoncé sa solidarité avec les lignes rouges éthiques d'Anthropic concernant la surveillance et les armes autonomes. Google est resté ostensiblement silencieux au moment de la publication, tandis que xAI n'avait publié aucune déclaration publique. Tegmark prédit que ce moment "montrera leurs vraies couleurs" et créera potentiellement une fragmentation de l'industrie. La question critique devient de savoir si les entreprises continueront à rivaliser sur les normes de sécurité ou convergeront vers les exigences gouvernementales. Quelques heures après l'interview de Tegmark, OpenAI a annoncé son propre accord avec le Pentagone, suggérant une possible divergence dans les stratégies d'entreprise malgré les déclarations publiques de solidarité.

La voie à suivre : De l'amnistie d'entreprise à la gouvernance responsable

Tegmark reste prudemment optimiste quant aux résultats positifs potentiels. "Il y a une alternative si évidente ici", explique-t-il. Traiter les entreprises d'IA comme les industries pharmaceutiques ou aéronautiques nécessiterait des tests rigoureux et une vérification indépendante avant le déploiement. Ce modèle d'"essai clinique" pour les systèmes d'IA puissants pourrait permettre des applications bénéfiques tout en prévenant les risques catastrophiques. La crise actuelle peut catalyser ce changement en démontrant l'instabilité de l'autorégulation volontaire. Les audiences du Congrès déjà prévues pour le mois prochain examineront probablement le cas Anthropic comme preuve d'une action législative urgente. La loi européenne sur l'IA, dont la mise en œuvre complète est prévue pour 2026, fournit un modèle réglementaire que les législateurs américains peuvent adapter ou rejeter.

Conclusion

La liste noire du Pentagone pour Anthropic expose le piège fondamental de l'autorégulation de l'IA — un système où les promesses de sécurité volontaires s'effondrent sous la pression commerciale et gouvernementale. Cette crise démontre que sans cadres juridiques contraignants, même les entreprises bien intentionnées font face à des choix impossibles entre les principes éthiques et la survie. Le vide réglementaire crée ce que Max Tegmark qualifie avec précision d'"amnistie d'entreprise", permettant des déploiements potentiellement dangereux tout en n'offrant aucune protection aux entreprises résistant aux demandes douteuses. Alors que les capacités de l'IA s'accélèrent vers la superintelligence, cet incident peut représenter un tournant vers une gouvernance sérieuse. L'alternative — la dépendance continue aux promesses non exécutoires — risque non seulement la stabilité des entreprises mais aussi la sécurité nationale et la sécurité publique. Le piège d'Anthropic sert d'avertissement sévère : l'autorégulation dans l'intelligence artificielle n'est pas seulement inadéquate mais dangereusement instable.

FAQs

Q1 : Pourquoi le Pentagone a-t-il mis Anthropic sur liste noire ?

Le Département de la Défense a rompu ses liens après qu'Anthropic a refusé de développer une technologie d'IA pour deux applications spécifiques : la surveillance de masse des citoyens américains et les drones armés autonomes capables de sélectionner et de tuer des cibles sans intervention humaine. Le Pentagone a invoqué une loi de sécurité nationale sur la chaîne d'approvisionnement généralement utilisée contre les menaces étrangères.

Q2 : Qu'est-ce que "l'amnistie d'entreprise" dans la réglementation de l'IA ?

Ce terme, utilisé par Max Tegmark, décrit le vide réglementaire actuel où les entreprises d'IA ne font face à aucune restriction légale ou conséquence pour les déploiements potentiellement nuisibles. Contrairement aux industries réglementées comme les produits pharmaceutiques ou l'aviation, les développeurs d'IA opèrent sans exigences obligatoires de tests de sécurité ou de certification.

Q3 : Comment les autres entreprises d'IA ont-elles réagi à la liste noire d'Anthropic ?

Le PDG d'OpenAI, Sam Altman, a publiquement soutenu les lignes rouges éthiques d'Anthropic, bien qu'OpenAI ait ensuite annoncé son propre accord avec le Pentagone. Google est resté silencieux initialement, tandis que xAI n'avait pas publié de déclaration. L'incident force les entreprises à révéler leurs positions sur les applications militaires de l'IA.

Q4 : Qu'est-ce que l'argument de la "course avec la Chine" contre la réglementation de l'IA ?

Les entreprises d'IA soutiennent fréquemment que tout ralentissement réglementaire céderait l'avantage aux concurrents chinois. Tegmark contre que la Chine met en œuvre ses propres restrictions sur l'IA et que le développement non contrôlé de la superintelligence menace tous les gouvernements, en faisant un risque de sécurité nationale plutôt qu'un atout.

Q5 : Quel modèle réglementaire alternatif les experts proposent-ils ?

De nombreux experts préconisent de traiter les systèmes d'IA puissants comme les produits pharmaceutiques ou les avions, nécessitant des tests d'"essai clinique" rigoureux et une vérification indépendante avant le déploiement. Cela remplacerait les directives volontaires par des normes de sécurité contraignantes appliquées par des agences de réglementation.

Cet article Liste noire du Pentagone pour Anthropic : Le piège dévastateur de l'autorégulation de l'IA exposé est apparu en premier sur BitcoinWorld.

Vous aimerez peut-être aussi

Chainlink (LINK) - Analyse d'investissement mars 2026

Prix d'Arbitrum sous pression : la vente de 60 millions d'ARB par une baleine suscite des craintes d'ATL